Was ist Sensation Seeking?

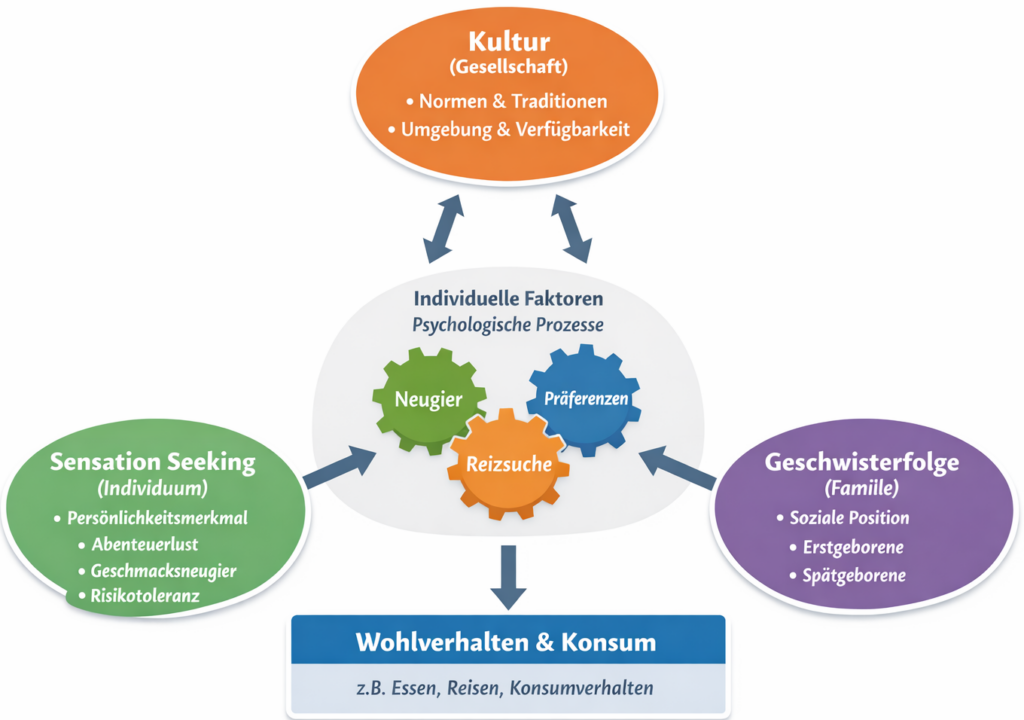

Sensation Seeking beschreibt ein Persönlichkeitsmerkmal, das mit dem Bedürfnis nach Neuheit, Intensität und Abwechslung verbunden ist. Das Konzept geht auf den Psychologen Marvin Zuckerman zurück und ist seit den 1960er-Jahren gut erforscht. Sensation Seeking hängt u.a. mit unserem Dopaminsystem (Belohnung & Motivation) zusammen. Mit Sensation Seeking lassen sich persönliche Unterschiede viel genauer fassen als reine Geschwisterfolgen oder eine kulturelle Eingebundenheit.

Sensation Seeking (deutsch oft: Sensationssuche oder Erlebnis-/Reizsuche) ist ein stabiles Persönlichkeitsmerkmal, das beschreibt, wie stark jemand nach neuen, intensiven, komplexen oder riskanten Erfahrungen sucht und wie viel Reizstimulation jemand braucht, um sich lebendig oder zufrieden zu fühlen.

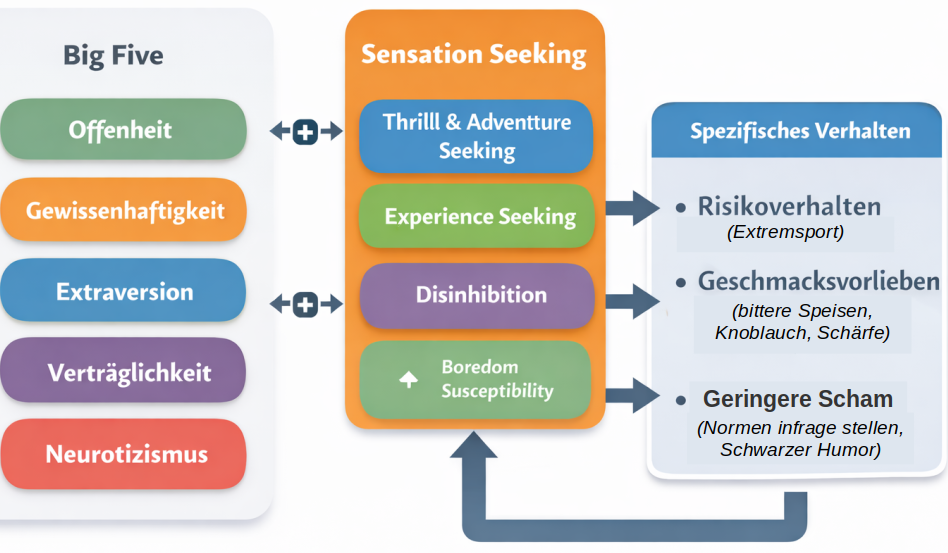

Sensation Seeking wird in vier Dimensionen aufgeteilt:

- Thrill and Adventure Seeking / Abenteuersuche: Suche nach körperlich riskanten Aktivitäten Beispiele: Fallschirmspringen, Klettern, Motorradfahren, Extrem- oder Outdoorsport

- Experience Seeking / Erlebnishunger: Suche nach neuen geistigen, kulturellen und sensorischen Erfahrungen Beispiele: Reisen in fremde Kulturen, Experimentieren mit Musik, Kunst, Subkulturen Neugier auf ungewohnte Speisen & Geschmäcker

- Disinhibition / Geringere Scham: Lockerung sozialer Normen, Suche nach enthemmenden Erlebnissen Beispiele: Partys, Nachtleben, Alkohol, Drogen, Spontane Entscheidungen → Nicht gleichbedeutend mit „asozial“, eher geringe Hemmschwelle

- Boredom Susceptibility / Ungeduld: Geringe Toleranz für Wiederholung und Monotonie Beispiele: Lange (Arbeits-) Routinen machen schnell unruhig

Diese Merkmale bilden sich zwar bei Kindern relativ stabil aus, sind jedoch (wie alles) auch abhängig u.a. von persönlichen Erfahrungen, Geschwisterfolgen oder einer kulturellen Einbettung:

Abgrenzung zu den Big-5

Während die Big Five zurecht sehr bekannt sind, weil sie breit, stabil und universell gelten, ist Sensation Seeking spezifischer, tiefer und verhaltensnaher. Wer z.B. verstehen will, warum jemand Knoblauch, Sardellen oder bitteres Bier liebt – oder Rückschlüsse von Konsum und Hobbys auf die Persönlichkeit ziehen will – ist mit Sensation Seeking besser bedient als nur mit den Big Five:

Typische Missverständnisse

- High Sensation Seeker sind verantwortungslos → Nein, viele sind sehr bewusst, brauchen jedoch mehr Reize, um sich wohl zu fühlen.

- Die Jugend will eben experimentieren → Die Präferenz für Sensation Seeking sinkt im Schnitt mit dem Alter, bleibt aber relativ stabil.

- Wer riskante Sportarten ausübt, geht auch gerne exotisch essen → Die Präferenzen in den vier Sparten sind unabhängig voneinander.

Sensation Seeking als Erklärung für Spannungen im Team

In Unternehmen wirken unterschiedliche Sensation Seeking-Ausprägungen oft im Hintergrund, beeinflussen aber Innovation, Risikoverhalten, Führung, Teamdynamik und Konflikte stärker, als vielen bewusst ist, zumal das Konzept kaum bekannt ist.

Es geht nicht primär um Mut oder Unsicherheit, sondern um Reizschwellen. High Sensation Seeker brauchen mehr Stimulation, Low Sensation Seeker fühlen sich schneller von neuen Situationen überfordert. In Teams können unterschiedliche Sensation Seeking Präferenzen daher zu Spannungen führen:

- Hohe Ausprägung → Ideen, Dynamik, Tempo

- Niedrige Ausprägung → Struktur, Verlässlichkeit, Umsetzung

Probleme entstehen weniger durch das Merkmal selbst als durch fehlende Rollenklärungen bzw. eine Unkenntnis der Ausprägungen im Team: Anstatt einer sinnvollen Ergänzung gibt es dann Vorwürfe in beide Richtungen.

Mitarbeiter*innen mit hohem Sensation Seeking treiben häufig Innovationen voran. Sie probieren neue Ansätze aus, stellen Routinen infrage und haben eine höhere Toleranz für Unsicherheit. Besonders in Bereichen wie Produktentwicklung, Strategie, Marketing oder Unternehmertum ist diese Eigenschaft wertvoll. Gleichzeitig neigen sie dazu, schneller gelangweilt zu sein, wenn Prozesse stark standardisiert sind.

Sensation Seeking beeinflusst auch, wie Risiken wahrgenommen und eingegangen werden. Führungskräfte mit hohen Werten treffen eher mutige Entscheidungen und investieren schneller in neue Chancen. Das kann in unklaren Situationen genau richtig sein, birgt aber auch die Gefahr von Fehleinschätzungen, wenn Kontrollmechanismen fehlen. Niedriger ausgeprägtes Sensation Seeking wirkt hier oft stabilisierend.

Teams profitieren daher enorm davon, wenn sie Sensation Seeking nicht bewerten, sondern passend einsetzen:

- Hohe Werte: explorative Aufgaben, Projektarbeit, Veränderungsinitiativen

- Niedrige Werte: Prozessstabilität, Qualitätssicherung, langfristige Planung

Und hier kommt noch ein Fragebogen zur Selbsteinschätzung.

Michael Hübler

Michael Hübler